持续攻关,天翼交通多项创新技术行业领先并推广应用

发表于 2024年12月23日近日,天翼交通提出一种新的LiDAR点云目标检测算法,空间扩展群变形,SEGT(Spatial Expansion Group Transformer)。这是一种基于 Transformer 的新型室外 3D 物体检测框架。SEGT通过引入一系列通用的空间扩展方法来增强性能,有效地提高了点云数据固有的空间特征的提取和表示。此外,它采用了有效的分组注意力机制,进一步完善了模型处理复杂点云数据的能力。不需要模型集成,仅结合测试时数据增强,TTA(Test-Time Augmentation),该算法在国际知名自动驾驶数据集nuScenes上取得第二名(NDS指标),其中平均精度均值,mAP(mean Average Precision)排第一。

图 nuScenes的LiDAR赛道最新榜单(截止2024年12月17日)

http://www.nuscenes.org/object-detection?externalData=all&mapData=all&modalities=Lidar

24年9月,世界三大顶级视觉会议之一ECCV(欧洲计算机视觉大会European Conference on Computer Vision)在意大利米兰召开。天翼交通和哈尔滨工业大学等单位联合署名发表论文《UniM2AE: Multi-modal Masked Autoencoders with Unified 3D Representation for 3D Perception in Autonomous Driving》。掩码自动编码器 (MAE) 在学习有效表示方面发挥着关键作用,在自动驾驶所必需的各种 3D 感知任务中提供出色的结果。我们深入研究了为自动驾驶中的统一表示空间量身定制的多模态掩模自动编码器,旨在开创两种不同模态的更有效融合。为了将图像固有的语义与 LiDAR点云的几何复杂性错综复杂地结合起来,我们提出了 UniM2AE。该模型是一个有效而简单的多模式自监督预训练框架。在国际知名自动驾驶数据集nuScenes 数据集上进行的大量实验证明了方法的有效性,在Camera赛道中取得第三名(NDS),其中,规划KL分歧,PKL指标排第二。

图 UniM²AE(a multi-modal self-supervised pre-training framework)架构示意图

图 nuScenes的Camera赛道最新榜单(截止2024年12月17日)

http://www.nuscenes.org/object-detection?externalData=all&mapData=all&modalities=Camera

单图像超分辨率在智能交通领域有着广泛的应用前景,如车牌识别、车型识别等。现有方法通常面临较高的计算和内存要求,限制了它们在实际应用中的实用性。24年8月,天翼交通和南京邮电大学等单位联合在IEEE会刊IEEE Transactions on Instrumentation and Measurement(影响因子:5.6)发表论文《Efficient Dual-branch Information Interaction Network for Lightweight Image Super-Resolution》。我们提出了一种轻量级且高效的双分支信息交互网络(DIIN)。DIIN采用与典型串行网络架构不同的双分支结构。具体来说,我们将CNN分支和Transformer分支设计为并行结构。在CNN分支中,我们采用对称双分支特征交互模块来提取有价值的局部特征信息。同时,Transformer 分支利用递归 Transformer 来捕获长期全局信息并增强重建图像细节。通过同时考虑这两个分支,我们的模型有效地结合了 CNN 在提取局部信息和 Transformer 在捕获全局信息方面的优势,并消耗更少的计算资源和内存,在智能交通中的车牌识别等场景成功应用,显著提高了低分辨率车牌的识别精度。

图 DIIN(Dual-branch Information Interaction Network)架构示意图

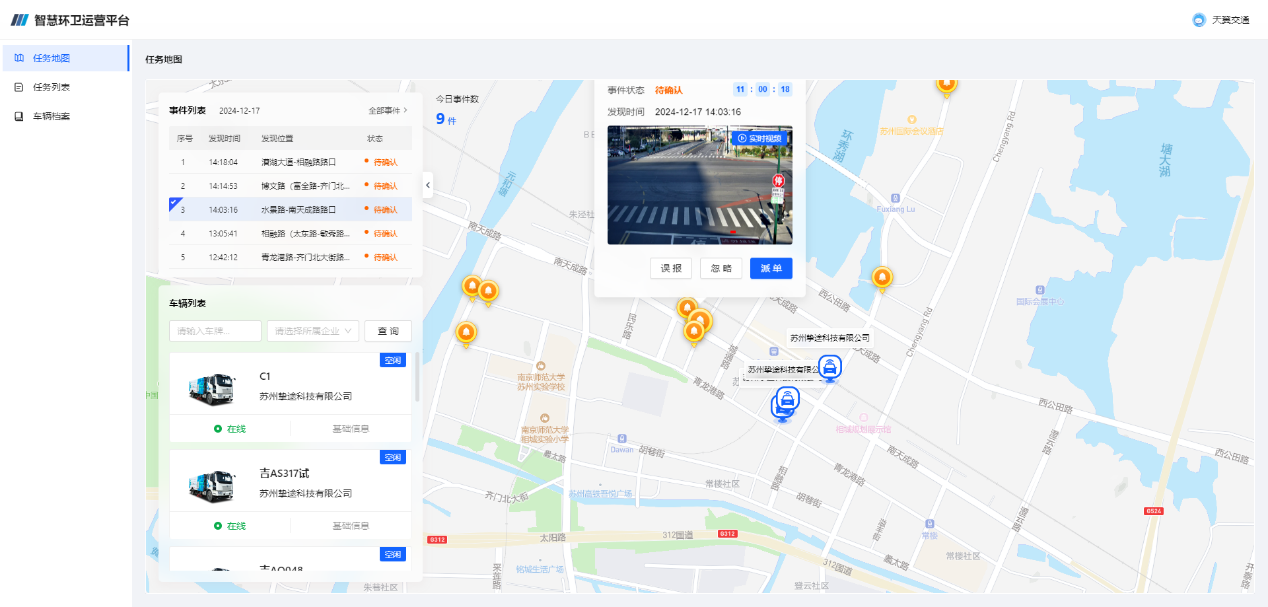

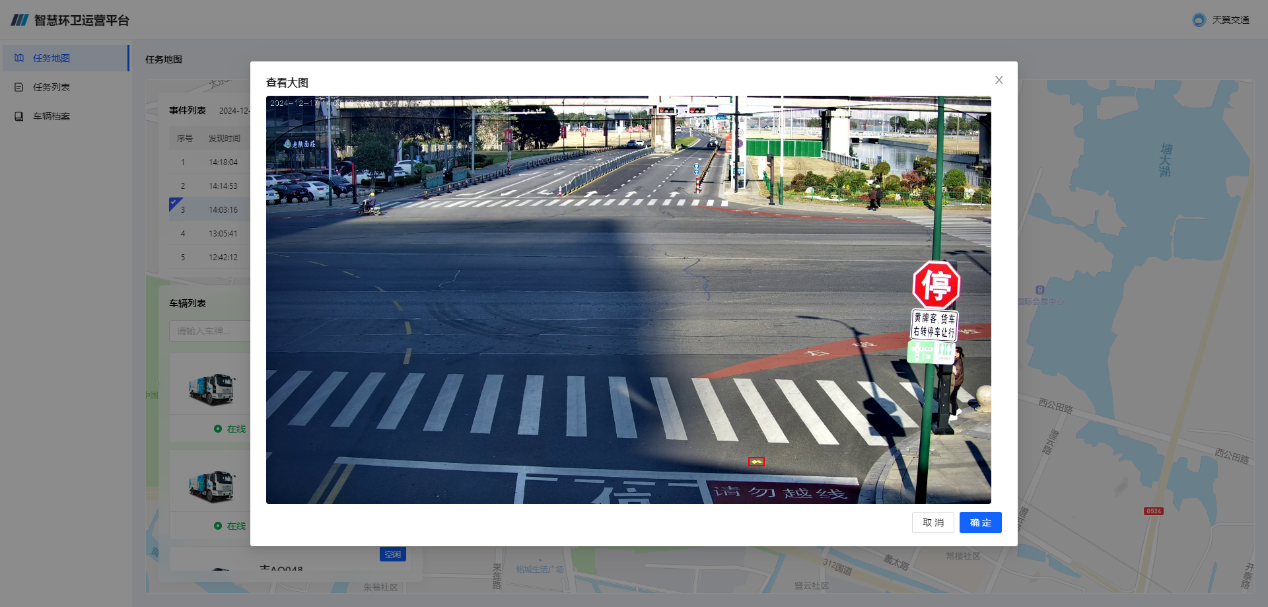

24年7月,多媒体技术及其应用领域的顶级国际会议之一ICME(International Conference on Multimedia and Expo)在加拿大举行。ICME由IEEE 四大协会Computer Society、Circuits and System Society、Signal Processing Society以及Communication Society共同主办,至今已连续举办20多届,涵盖文本分析、图形图像、视频处理、语音和音频信号处理等主题。天翼交通和南京信息工程大学等单位联合署名发表论文《Language-Guided Semantic Alignment for Co-saliency Detection》。协同显着性检测范例主要采用监督训练。监控信号通常由二进制掩码或掩码和类别标签的组合组成。然而,受训练样本有限的限制,这些模型经常出现过拟合问题,难以推广到未见过的样本,特别是道路上的抛洒物检测,可能包括垃圾、碎片、轮胎、树枝、动物尸体、食品包装、建筑材料等多种类型。为此,我们提出了对比语言图像预训练 COD(CLIPCOD),这是一种新颖的语言引导语义对齐范例协同显着性检测。利用CLIP来对齐语言和图像之间的概念,这种对齐可以有效地利用CLIP强大的语言理解能力并将其知识转移到图像领域,从而增强模型对协同显着性检测的泛化能力,显著提高了道路抛洒物特别是垃圾的检测性能。近期与生态伙伴挚途科技,协同开发并上线了智慧环卫运营平台,可实现垃圾发现、清扫任务生成和下发、环卫车调度和垃圾清扫、任务实时监控、任务留证闭环的全流程环卫清理功能,帮助苏州城管用户及时发现并调度环卫车辆清理路面垃圾,保证市容整洁。

图 CLIP-COD(Contrastive language-image pretraining - Co-saliency Detection)架构示意图

图 智慧环卫运营平台截图

近一年来,天翼交通多项研究成果受到国际顶级学术会议/期刊认可,达到世界领先水平,并且在实际应用中得到验证,加速车路云一体化产业的关键技术迭代。

商务合作邮箱 marketing@tyjt-ai.com

苏州

苏州市相城区高铁新城青龙港路286号长三角国际研发社区启动区主楼9A座8层

深圳

深圳市宝安区新安街道兴东社区69区洪浪北二路26号信义领御研发中心8栋907

版权所有 © 天翼交通科技有限公司 | 苏ICP备2022036366号-2